Nano banana 体验最直观的就是速度。以往在使用一些开源模型时,哪怕你电脑配置不错,从输入提示到生成一张像样的图,也得等个几十秒甚至更久。对于手机端用户来说,这个等待过程更是煎熬。

但 Gemini 2.5 Flash Image 把这个门槛直接拉低到了几秒钟的级别。它本身是 Google 宣称的「最新、最快、最高效」的原生多模态模型,在优化上明显下了很大功夫。我在实际测试时,输入一句提示,大概三四秒就能生成结果,而且分辨率和细节都相当清晰。

这种体验很像我们日常用美图秀秀处理照片:点一下「美颜」按钮,几乎是即时见效。区别在于,美图秀秀是用算法套现成滤镜,而 Gemini 2.5 Flash Image 是在从零构建一张图,或者把一张照片按你的需求进行大幅改造。这种「指哪打哪」的爽感,是以往繁琐的 P 图流程完全不可想象的。

类似这种「删除路人背景」的需求,只需要一个 Prompt 就能解决 | 图片来源:极客公园

如果说速度解决的是传统 P 图用户的体验感,那么「原生多模态」解决的就是 AI图片能力边界。

Gemini 2.5 Flash Image 不仅能生成图片,还能同时理解文字和图像输入。这意味着我可以把一张照片和一段文字提示同时给它,它会结合两者的信息去理解我到底想要什么。

举个例子,我上传了一张在街头拍的照片,然后告诉它「把背景改成东京新宿的夜景」。结果它不仅识别出了我上传照片里的主体,而且准确地把人抠出来,背景替换成了霓虹灯闪烁的新宿街头。更难得的是,它还保持了人物光影的统一,完全没有人手抠图经常无法避免的那种「硬抠贴」的效果。

这种理解力让我想起近几年手机厂商在系统自带相册中经常被提到的一个功能——「一键换背景」。但区别在于,当年的换背景常常边缘发虚、光影不对,效果很假。而现在,Gemini 2.5 Flash Image 能用世界知识和视觉理解来补足这些细节,结果自然得多,获得了远比传统文生图/图生图模型工具更准确的画面细节保留。

原图 & Gemini 2.5 Flash Image 生成效果 | 图片来源:极客公园

这也是为什么我觉得它会重新定义修图体验:不再是依赖大量手工调整,而是靠模型的自然语义理解来「大力飞砖」式的完成任务,例如在人像 P 图这种对画面细节要求极高的场景。

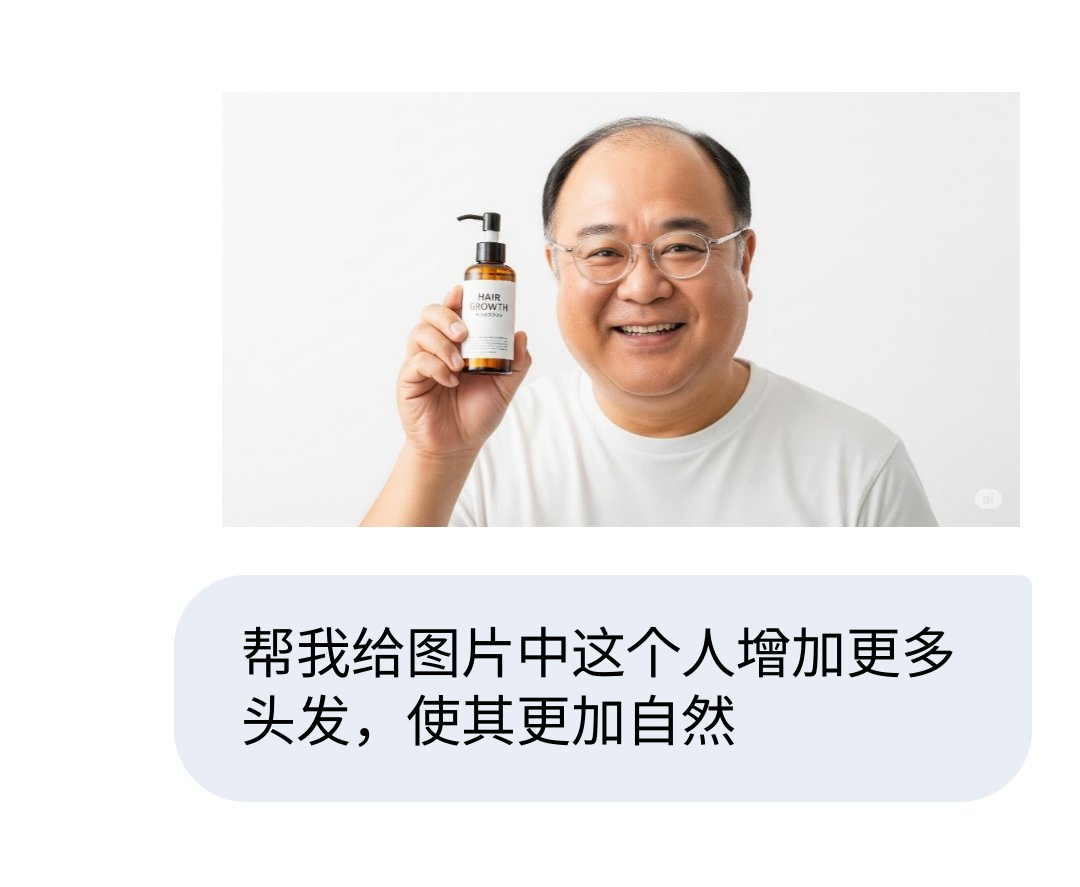

对于这种人像图片处理需求,Gemini 2.5 Flash Image 的角色一致性真的提供了一种前所未有的「Vibe Photoshoping」体验。